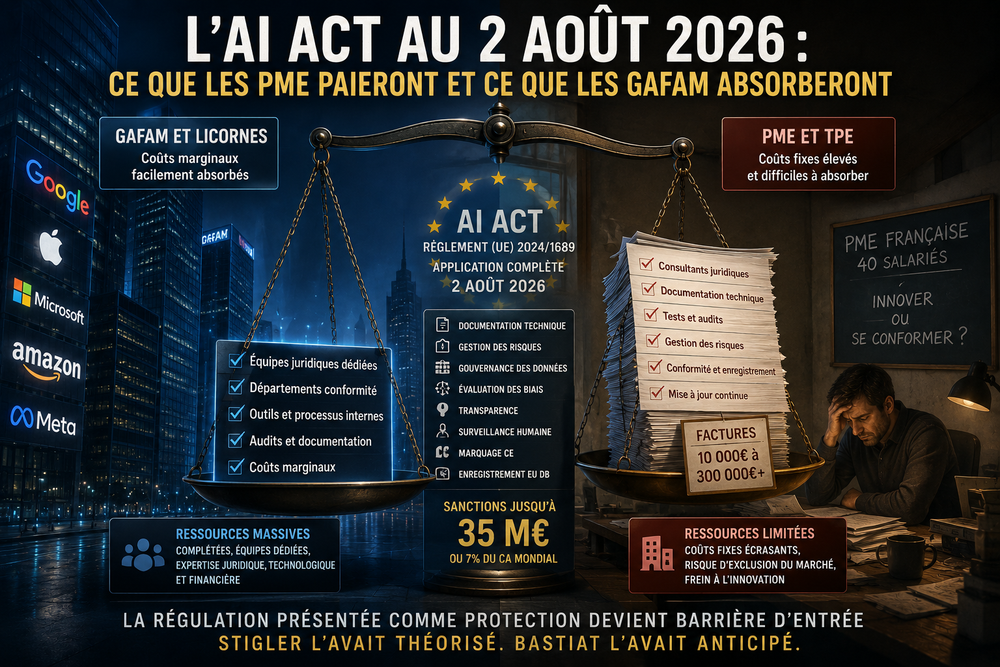

Le 2 août 2026, l'AI Act devient pleinement contraignant pour les systèmes d'IA à haut risque. Sanctions maximales : 35 millions d'euros ou 7 % du chiffre d'affaires mondial. Les obligations — documentation technique, gestion des risques, marquage CE — sont à coût fixe. Elles sont marginales pour Mistral, OpenAI ou Google, écrasantes pour les 6 200 PME identifiées par la Commission européenne. La régulation présentée comme protection devient barrière d'entrée. George Stigler avait théorisé le mécanisme en 1971. Bastiat l'avait disséqué en 1845. Le débat n'a presque pas eu lieu.

Une PME française qui voudra utiliser l'intelligence artificielle pour trier des candidatures, à partir du 2 août 2026, devra constituer un dossier de conformité comparable, dans son volume et sa technicité, à celui que la pharmacie présente pour une autorisation de mise sur le marché. Documentation technique complète du système. Description des données d'entraînement, de validation et de test, avec leurs sources, leur qualité, leurs biais connus. Évaluation des risques pour la santé, la sécurité et les droits fondamentaux. Tests réguliers, analyse des biais, mitigation documentée. Inscription dans la base de données de l'Union européenne. Marquage « CE » avant commercialisation. Sanctions en cas de manquement : jusqu'à trente-cinq millions d'euros ou sept pour cent du chiffre d'affaires mondial.

Mistral, OpenAI, Google, Microsoft et Meta ont tout cela en interne depuis longtemps. Une PME française de quarante salariés, non.

C'est, en quelques lignes, le décor que la régulation européenne sur l'intelligence artificielle installe à partir de cette date. Le règlement (UE) 2024/1689, adopté le 13 juin 2024, est entré en vigueur le 1er août 2024. Ses principales obligations, qui concernent les systèmes d'IA à haut risque, deviennent pleinement contraignantes le 2 août 2026 — soit dans moins de trois mois. Le débat public continue, comme depuis deux ans, à se concentrer sur le contenu philosophique du texte. Il évite presque entièrement la question de ses effets distributifs. Il aurait pourtant mérité que Bastiat soit relu.

L'événement

Le règlement classe les systèmes d'IA en quatre catégories de risque. Les systèmes à risque inacceptable (notation sociale, manipulation cognitive, catégorisation biométrique des personnes physiques pour caractéristiques sensibles) sont interdits depuis février 2025. Les systèmes à risque limité (chatbots, contenus générés par IA) font l'objet d'obligations d'information, plus légères. Les systèmes à risque minimal (filtres anti-spam, jeux vidéo) sont libres.

Au cœur du texte : la catégorie des systèmes à haut risque. Elle vise des cas d'usage très précis — la biométrie, les infrastructures critiques, l'éducation, l'emploi (recrutement, gestion des employés, accès à la formation), l'accès aux services privés essentiels (crédit, assurance), l'application de la loi, la migration et le contrôle aux frontières, l'administration de la justice, les processus démocratiques, les dispositifs médicaux. Pour ces systèmes, le règlement impose un régime complet : système de gestion des risques, gouvernance des données, documentation technique, traçabilité, transparence et information des utilisateurs, surveillance humaine, robustesse, exactitude, cybersécurité.

Le 2 août 2026 marque la date à laquelle l'ensemble de ce régime devient opposable aux entreprises qui développent ou déploient des systèmes haut risque déjà identifiés. Le 2 août 2027, ce régime s'étendra aux systèmes haut risque incorporés dans des produits déjà réglementés (jouets, dispositifs médicaux, machines). En cas de non-conformité, l'article 99 du règlement prévoit des sanctions à trois niveaux : trente-cinq millions d'euros ou sept pour cent du chiffre d'affaires mondial pour les manquements les plus graves, quinze millions ou trois pour cent pour les autres, sept millions ou un pour cent pour la fourniture d'informations inexactes aux autorités. C'est l'un des régimes de sanctions les plus sévères de l'histoire réglementaire européenne — comparable au RGPD, supérieur à la plupart des sanctions financières.

Le calcul concret

Pour comprendre l'effet distributif du dispositif, il faut faire un calcul que personne ne fait publiquement. Mettre un système d'IA en conformité avec les exigences du règlement coûte une certaine somme. Cette somme se compose principalement de coûts fixes : un consultant juridique pour interpréter les obligations, un consultant technique pour produire la documentation, un système de gestion des risques à intégrer dans le développement, des audits internes, le cas échéant un audit externe. À cela s'ajoutent des coûts variables modestes (mise à jour de la documentation au fil des versions du modèle).

L'ordre de grandeur, pour une PME française qui souhaite déployer un système haut risque (par exemple un outil d'aide au recrutement utilisant l'IA), oscille selon les premiers retours de cabinets de conseil en conformité spécialisés entre quelques dizaines de milliers et plusieurs centaines de milliers d'euros pour la mise en conformité initiale, hors coûts récurrents. Pour OpenAI, dont le chiffre d'affaires annualisé se compte en milliards de dollars en 2025, la même mise en conformité, déjà largement intégrée à ses processus internes, représente une fraction négligeable de ses charges fixes. Pour Mistral AI, la fonction « compliance » est intégrée à la structure depuis l'origine.

Le résultat est mécanique. Un même coût fixe absorbé par une entreprise qui réalise un milliard d'euros de chiffre d'affaires représente, en proportion, un dixième de millième de celui que représente le même coût pour une entreprise qui en réalise dix millions. La régulation, par construction, n'est pas neutre par rapport à la taille. Elle pèse infiniment plus sur le petit que sur le grand — et la qualité de service du petit ne peut, à elle seule, compenser ce différentiel quand la conformité est une condition d'accès au marché.

La Commission européenne a identifié 6 200 micro et petites entreprises potentiellement impactées par le règlement. Le 20 janvier 2026, dans son paquet cybersécurité, elle a présenté des mesures de simplification pour les bacs à sable réglementaires destinés à les accompagner. L'article 57 du règlement impose à chaque État membre de mettre en place au moins un bac à sable opérationnel d'ici le 2 août 2026. À cette date, la plupart des pays n'ont pas commencé à structurer ces dispositifs. L'Espagne fait exception, avec son agence dédiée AESIA opérationnelle depuis 2023. La France a confié la coordination à la CNIL, qui doit articuler ses compétences historiques sur les données personnelles avec les nouvelles exigences.

Autrement dit : le dispositif d'accompagnement des PME, présenté comme la contrepartie de l'exigence réglementaire, n'est pas prêt là où l'exigence, elle, l'est.

Le mécanisme structurel

À ce stade, l'objection naturelle est qu'on présente une situation transitoire comme un défaut structurel. C'est inexact. Le mécanisme à l'œuvre n'est pas spécifique à 2026 ; il a été décrit, théorisé, et empiriquement validé depuis plus d'un demi-siècle.

George Stigler, professeur d'économie à Chicago et futur prix Nobel, a publié au printemps 1971 dans le Bell Journal of Economics and Management Science un article devenu canonique : « The Theory of Economic Regulation ». Sa thèse était simple, et corroborée par une étude empirique massive : « Regulation is acquired by the industry and is designed and operated primarily for its benefit. » Loin d'être un dispositif imposé aux acteurs économiques contre leur volonté, la régulation tend, à mesure qu'elle se développe et se complexifie, à être façonnée par les acteurs régulés eux-mêmes, à leur bénéfice.

Le mécanisme est triple. D'abord, l'asymétrie d'information : les acteurs régulés connaissent leur secteur en détail, le régulateur n'en a qu'une vision agrégée et dépend des informations qu'il reçoit — donc, en pratique, des acteurs eux-mêmes. Ensuite, l'asymétrie d'intérêt, théorisée parallèlement par Mancur Olson en 1965 dans La logique de l'action collective : un petit nombre d'acteurs concentrés (les industriels) a un intérêt fort à influencer la régulation ; un grand nombre d'acteurs diffus (les consommateurs, les nouveaux entrants potentiels) a un intérêt faible — le coût d'organisation est, pour ces derniers, supérieur au gain individuel attendu. Enfin, l'asymétrie de coûts fixes que nous venons de détailler : toute complexité ajoutée à la régulation favorise structurellement ceux qui peuvent l'absorber.

L'AI Act n'échappe pas au mécanisme. Les principaux acteurs de l'IA, américains et européens, ont activement participé à la rédaction du texte via les multiples consultations organisées entre 2021 et 2024. Le résultat n'est pas, en soi, une mauvaise régulation : il est une régulation conçue par et pour des acteurs qui peuvent en supporter le coût. Pour ceux qui ne le peuvent pas — la PME française qui voulait utiliser l'IA pour son service RH, le développeur indépendant qui voulait commercialiser un outil sectoriel, l'éditeur de niche qui voulait intégrer un assistant — la barrière d'entrée vient de monter d'un cran.

La grille Bastiat

Frédéric Bastiat avait, en 1845, écrit dans la première série de ses Sophismes économiques un texte court intitulé « Pétition ». Dans ce texte, des fabricants de chandelles demandaient au gouvernement, sous une plume parfaitement sérieuse, de protéger leur industrie contre la concurrence déloyale du soleil — qui éclairait gratuitement, à toute heure du jour, et menaçait l'emploi du secteur. La pétition demandait l'obligation d'obstruer toutes les ouvertures par lesquelles la lumière naturelle pénétrait dans les habitations.

Le texte est une satire ; il est aussi une démonstration. Bastiat montrait que toute mesure protectrice présentée comme défensive (« protéger l'emploi », « protéger la qualité », « protéger le citoyen ») peut, sans qu'on en change un mot, être lue comme offensive (« interdire un concurrent moins coûteux »). La distinction n'est pas dans l'intention du législateur ; elle est dans la structure de l'effet. Une mesure produit ce qu'elle produit, indépendamment de ce que ses promoteurs en disent.

L'AI Act n'est pas la pétition des fabricants de chandelles. La protection contre les usages abusifs de l'IA — discrimination dans le recrutement, opacité dans le crédit, surveillance non consentie — est un objectif légitime auquel les libéraux classiques eux-mêmes peuvent souscrire : la protection de la liberté individuelle contre les pouvoirs arbitraires, qu'ils soient publics ou privés, est un fondement de la doctrine. Le problème n'est pas que le règlement régule. C'est qu'il régule d'une manière qui transfère le coût aux acteurs les plus petits et qu'il convertit, ce faisant, un objectif de protection en un mécanisme de fermeture du marché.

Une régulation libérale-classique de l'IA serait pensable. Elle reposerait sur trois principes — qui sont, à peu près, les principes que Hayek a formulés à propos de toute régulation dans Droit, législation et liberté (1973-1979) : exigence de règles générales et abstraites plutôt que d'autorisations particulières ; proportionnalité des coûts à la taille de l'entité régulée ; clarté du régime de responsabilité civile et pénale ex post, plutôt qu'autorisations ex ante. Le RGPD, dont l'AI Act s'inspire, avait fait certains de ces choix ; l'AI Act, lui, opte délibérément pour le régime inverse — autorisations ex ante, coûts fixes uniformes, marquage CE comme condition d'accès.

Le résultat tiendra, dans les années qui viennent, à un effet d'accumulation. Quelques systèmes haut risque se conforment ; les startups qui auraient pu en proposer renoncent ; les acteurs en place n'ont plus à se soucier de concurrents émergents. La rente de situation s'installe. Au bout de cinq ans, la « souveraineté européenne en IA » tant invoquée se résume à un oligopole sécurisé par la régulation. C'est exactement ce qui s'est produit dans la chimie, dans la pharmacie, dans la finance, dans tous les secteurs où la complexité réglementaire a fini par devenir un actif des acteurs installés.

Stigler avait raison : la régulation est acquise par l'industrie. Bastiat avait raison : ce qu'on voit (la protection des citoyens), ce qu'on ne voit pas (la protection des oligopoles). Le 2 août 2026, l'Europe entrera dans la phase d'application complète de cette logique appliquée à l'intelligence artificielle. Le débat n'aura pas eu lieu.

Sources et références

Sources primaires :

- Règlement (UE) 2024/1689 du Parlement européen et du Conseil du 13 juin 2024 établissant des règles harmonisées concernant l'intelligence artificielle (« AI Act »). Texte intégral sur EUR-Lex.

- Article 6 : classification haut risque

- Articles 8-15 : exigences applicables aux systèmes haut risque

- Article 49 : enregistrement dans la base de données UE

- Article 57 : obligation pour chaque État membre de créer au moins un bac à sable réglementaire d'ici le 2 août 2026

- Article 99 : sanctions (jusqu'à 35 M€ ou 7 % du CA mondial)

- Article 113 : application progressive

- Commission européenne, paquet cybersécurité du 20 janvier 2026 — mesures de simplification pour les bacs à sable réglementaires destinés aux PME. Identification de 6 200 micro et petites entreprises potentiellement impactées.

- CNIL, DGCCRF, Arcom — autorités françaises désignées pour l'AI Act.

Sources doctrinales :

- George J. Stigler, « The Theory of Economic Regulation », The Bell Journal of Economics and Management Science, vol. 2, n° 1, printemps 1971, p. 3-21. Article fondateur de la théorie de la capture réglementaire.

- Mancur Olson, The Logic of Collective Action: Public Goods and the Theory of Groups (1965), édition française Logique de l'action collective, PUF, 1978.

- Frédéric Bastiat, Sophismes économiques (1845), première série, chapitre 7, « Pétition ». Édition de référence : Œuvres complètes, Guillaumin, t. IV, 1854 ; édition moderne disponible chez l'Institut Coppet.

- Friedrich Hayek, Droit, législation et liberté (1973-1979, trois volumes : Règles et ordre 1973 ; Le mirage de la justice sociale 1976 ; L'ordre politique d'un peuple libre 1979). Édition française : PUF, 1980-1983.

Citations directes mobilisées :

- George Stigler (1971) : « Regulation is acquired by the industry and is designed and operated primarily for its benefit. »